图书馆专用设备

60亿AI独角兽Mistral祭出磁力链,但被大佬曝出评测作秀

裁剪:桃子 好困

【新智元导读】一条磁力链,又在AI圈掀翻狂澜。成就一年法国AI独角兽Mistral,官宣首个多模态模子Pixtral 12B,不仅能看懂手绘稿,还不错认知复杂公式、图表。

法国AI初创Mistral AI,又扔出一条磁力链炸场了。

此次,与以往不同的是,他们发布了首个多模态模子Pixtral 12B,集语言、视觉材干于并立。

这意味着,Mistral AI认真跨界MMML,开启多模态AI新时间,同期向OpenAI、Anthropic等强敌发起挑战。

多模态Pixtral 12B,是基于文本模子Nemo 12B完成测验。

与GPT-4o、Claude肖似,只需上传一张图、提供一个长入,模子就能凭证提醒恢复问题。

它不仅能够识别复杂手写札记,还能看懂数学公式、图表等等。

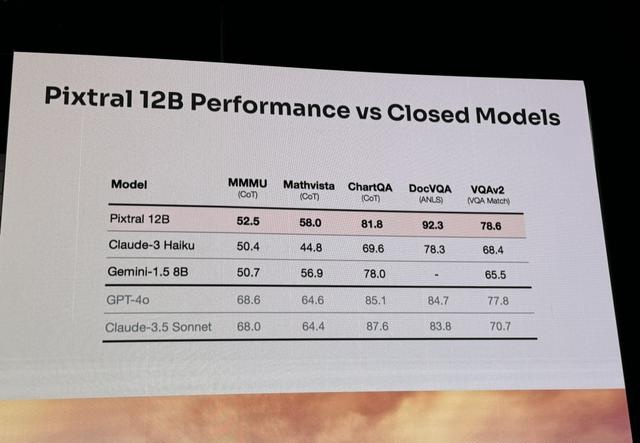

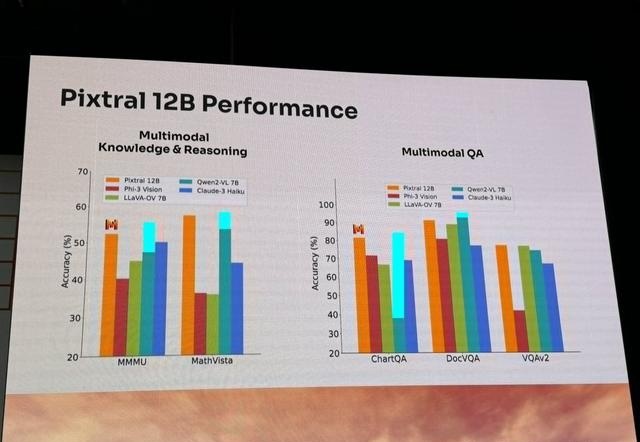

在多项基准测试(文本、指示随从、多模态)中,新模子性能大幅特出Qwen2 7B、Phi-3 Vision开源模子。

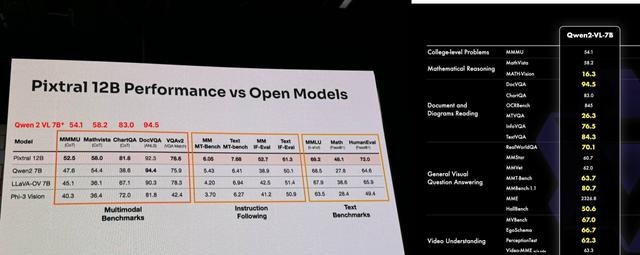

Hugging Face时候负责东谈主发现此处列举的Qwen的数据问题很大

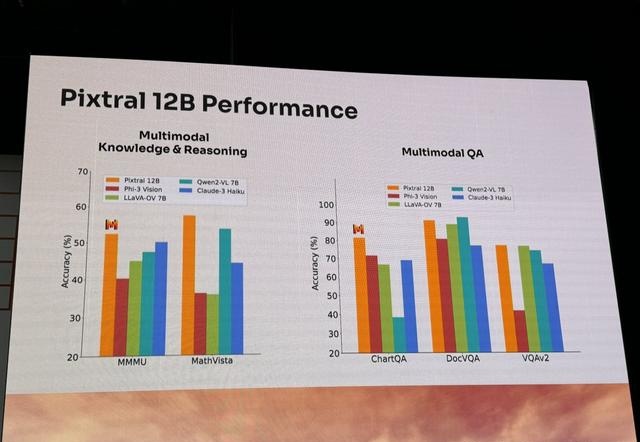

相较于闭源模子,Pixtral 12B在图表问答、文档问答、视觉数学推理、大学水平多学科等基准中,性能碾压Claude3 Haiku、Gemini 1.5 8B。

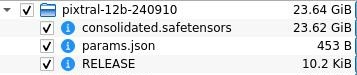

除了大要24GB的磁力链,模子代码还可在HuggingFace、GitHub下载。(由社区开辟者上传)

地址:https://huggingface.co/mistral-community/pixtral-12b-240910

值得一提的是,Mistral AI现场还请来了老黄镇守。

手绘稿直出代码,现场Demo惊艳

Mistral AI在旧金山举办的首届AI峰会上,初度展示了Pixtral 12B的多模态材干。

现场,足以用触动形容。

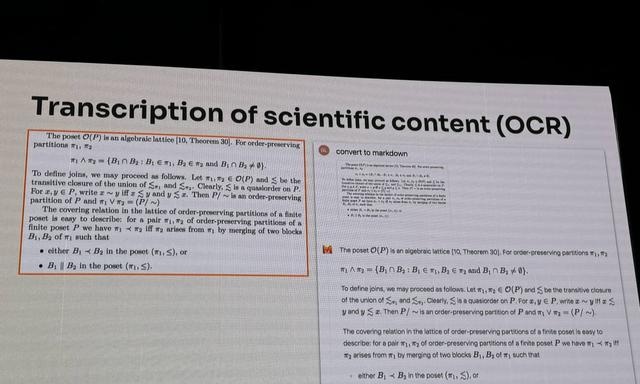

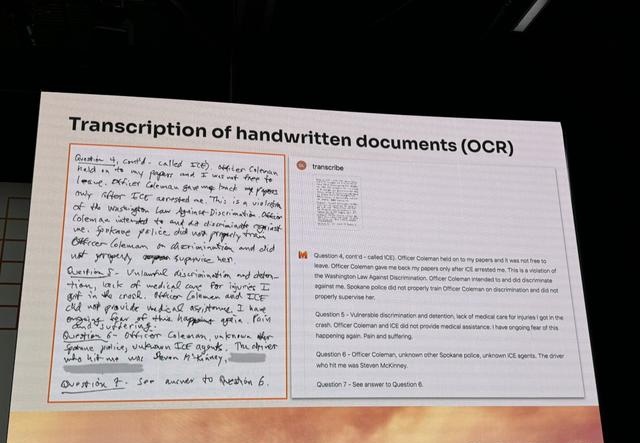

让它将一份科学答复转录为Markdown表情,不错看到图片中,包含了很多复杂的数学符号,还有公式。

Pixtral 12B通过OCR材干,精确地识别出整个的实质。

再来一个更复杂的手写作,别说AI了,小编也有些看不清写的什么字。

没念念到,这也难不倒它。

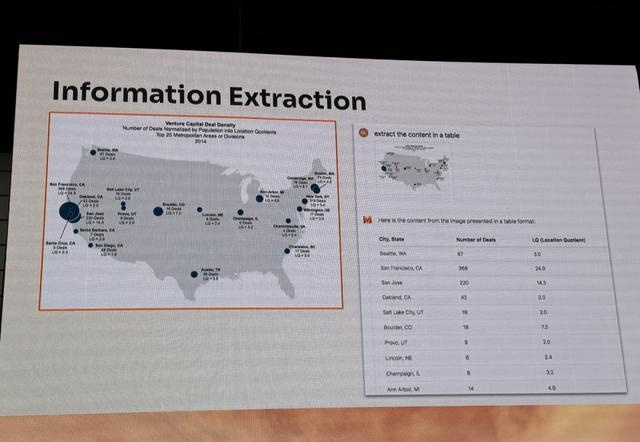

给它扔一张对于好意思国「风险投资来去密度溜达」的图表,并将其总结成一份表。

模子以不同州/城市,以及来去数目、区位商(LQ),列出了很是明晰的表格。

再来望望,它如何去描写一张图像的。

上传一张风景图,然后盘问「咱们不错从中看到什么」?

Pixtral 12B先从多样动物近景描写,再延迟到背后建筑、基础步伐,以及大树、天外云彩等。

通盘叙述的经过,很是有逻辑。

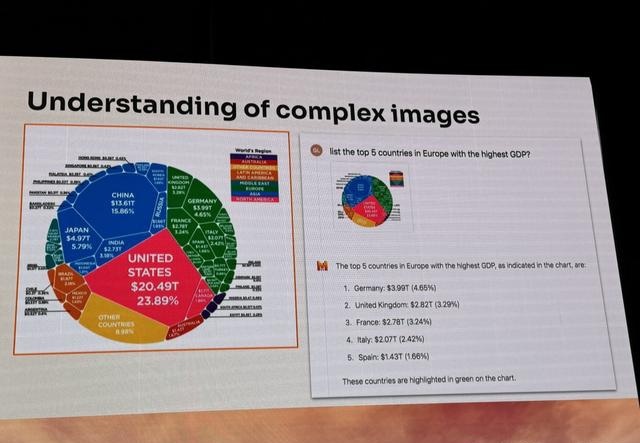

在复杂图表方面,Pixtral 12B认知力亦然一绝。

上传一张群众不同国度GDP图片,让它给出欧洲中GDP最高的5个国度。

模子凭证绿色欧洲区域,总结给出了相应的谜底。

不仅如斯,它还不错讲明科学答复中,图表中DNA结构的具体含义。

念念要搭建一个网页,手绘一张草稿,传给模子。

它能看着图直出代码,一个网页HTML的打算分分钟就处置了。

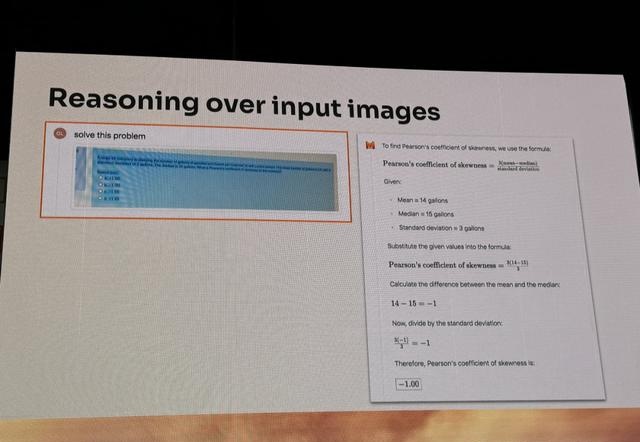

又或是,当你遭遇一谈数学推理难题,拍好相片上传给Pixtral 12B,便会获取解题才略和谜底。

出门餐饮小票,它也不错将其中信息提真金不怕火成JSON表情。

这样一通看下来,一个120亿参数的小模子,竟具备了如斯强劲的图像识别、文才略路材干。

那么,它是如何测验而来?背后架构是什么?

模子架构

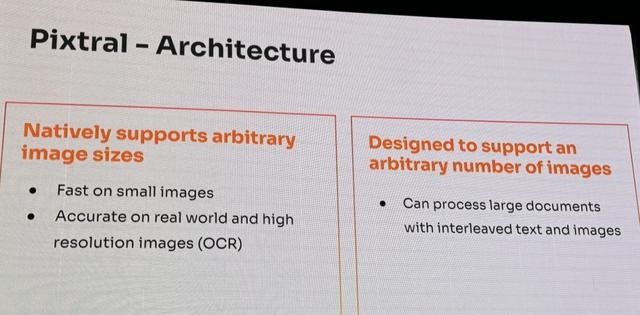

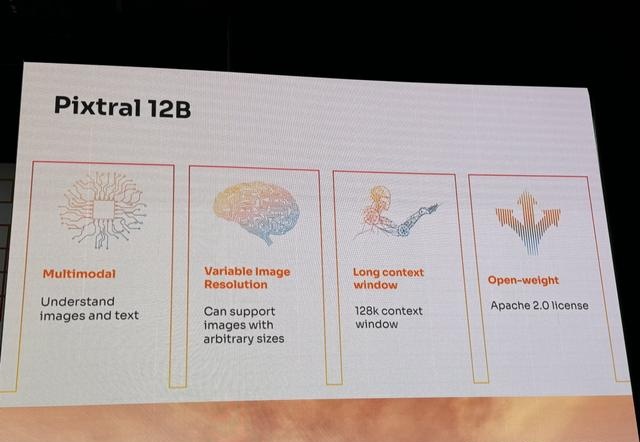

现场的先容中,Pixtral 12B的架构如下图所示。

它包含了一个多模态Transformer解码器,还有视觉Transformer编码器,能够认知原生的图像和文档。

正如来源所述,新模子是基于Nemo 12B完成搭建,对于测验数据面前仍在守密中。

开辟者关系附近Sophia Yang默示,「Pixtral 12B独到之处在于,能够原生扶植大肆数目、大小的图像」。

它能够快速处理小图像,还不错精确处理确切寰球和高分袂率的图像。况且,扔出一个图文混杂的大型文档,也能信手拈来。

Pixtral 12B的高下文长度为128k。

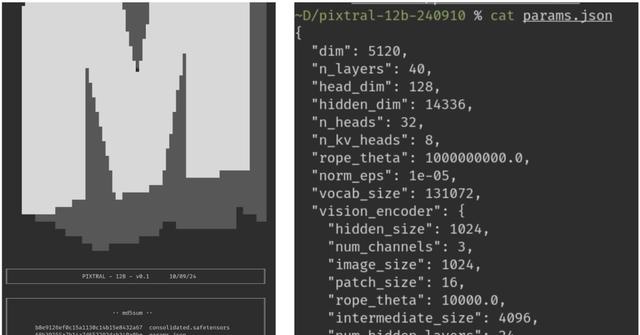

凭证开动测试者的共享,这个24GB模子架构共有40层,14336个荫藏维度,32个细心力头,用于平庸的计较处理。

在视觉方面,它还有一个专用的视觉编码器,可扶植1024×1024图像分袂率,以及24个荫藏层用于高等图像处理。

相关词,当Mistral最终通过API提供该模子时,可能会有所蜕变。

就性能来说,Pixtral 12B在多模态常识和推理基准(MMMU、MathVista)、多模态问答基准(ChatQA、DocVQA、VQAv2)上,全齐碾压现时跳跃的同等参数的模子。

比如,Qwen2-VL、LLaVA-OV、Phi-3 Vision等。

而在指示随从(多模态、文本)、文才略路(科学、数学、代码)基准上,Pixtral 12B进展也很是出色。

约略多模态模子对于咱们来说,论千论万,但Pixtral 12B对于Mistral来说是创举历史。

自前年景就以来,Mistral凭借开源忘形OpenAI等跳跃本质室大模子,一齐走红获取AI社区的招供。

几个月前,它以60亿好意思金估值,完成6.4亿好意思元新一轮融资,并随之推出了一款GPT-4级别的模子——Mistral Large 2。

此外,他们在本年,还推出了一个内行搀杂模子Mixtral 8x22B,包含了一个编码模子Codestral,以及一个数学推理和科学发现的模子。

Mistral约略有实力,成为下一个OpenAI。

穿上皮夹克,和老黄炉边语言

更让东谈主惊喜的是,大会现场,还献技了经典「皮夹克帮」集合的一幕。

创始东谈主Arthur Mensch穿上皮夹克和老黄坐在台前,开启了炉边语言,沿路接洽了将来AI和算力问题。

老黄默示,在英伟达,GPU的打算、性能、耗能等方面问题,仍将抓续优化。

他们但愿哄骗AI先去探索众多打算空间的可能性,然后再进行削弱,最终专注于有远景的解决决策。

老黄还以为:推理在今天是一次性的,但在将来不会是这样。为了落幕这少许,还需把推理速率普及到一个数目级。

因为,哄骗GPU作念推理濒临着显耀的艰难,英伟达90%的工程师齐投在了推理,而非测验中。

固然,英伟达对推理时候架构的探索,仍在不绝。老黄但愿NVLink能够落幕低延迟高隐隐量的推理打算。

对于AI将来的探索,老黄默示我方最可爱的AI应用,即是创建数字东谈主。

他但愿,将来公司会稀有百万个智能体数字职工,不错自主互相调换,运交易务。

此外,他还联系了英伟达在「类东谈主机器东谈主」限制的大批责任。

而它的发展,受到了老黄所言的「3台计较机问题」的瓶颈制约——

第一台用于测验多模态模子,第二台用于精确物理模拟和生成合成数据(NVIDIA Omniverse),第三台是机器东谈主体内的计较机(行将推出的NVIDIA Thor)。

终末,老黄还追思了英伟达历史,「在1993年景就之时,咱们在GPU限制还莫得竞争敌手,到1994年有10个,1995年有50个,然后有100个,竞争敌手速即增多」。

在竞争这样犀利限制中,英伟达能够有所成,一定进程上,不错悔怨于你所作念的事情与作念这些事情的原因不同。

英伟达是PC游戏行业的最大鼓吹者,他们通过创建计较平台、生态系统来创造一个新市集,使之成为「家庭的一部分」。

他们早先在游戏限制作念到了这少许,然后是科学计较,面前是AI。

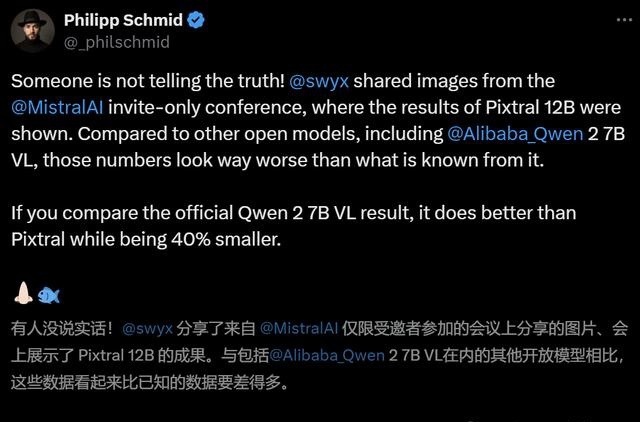

大佬发现「华点」:又来一个评测作秀的?

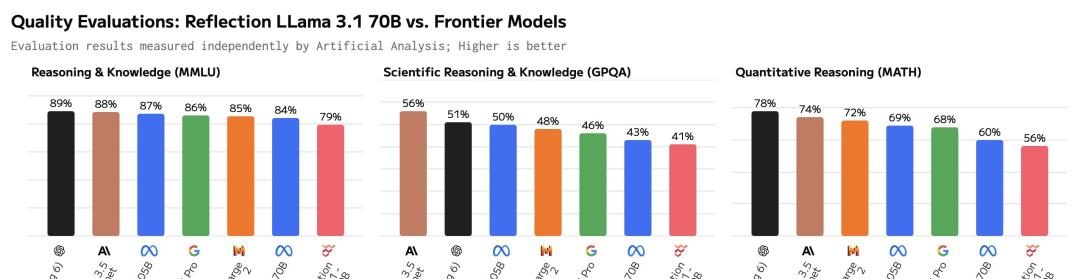

前两天,所谓的「开源新王」Reflection 70B才刚刚深陷Benchmark作秀争议。

如今,相同的剧情再次献技。

跟着峰会现场的相片大规模流出,Hugging Face时候负责东谈主Philipp Schmid也在第一时候发现,Mistral AI放出的跑分和Qwen 2 VL 7B的官方数据大相径庭。

把数据补全到柱状图中后不错看谈,Pixtral 12B在多项评测中的得益齐明显不如Qwen 2 VL 7B。

也就是说,Mistral AI的首个多模态模子,被一个参数目小了近42%的模子,吊打了!

此外,还有网友指出,别说数据有问题,他们连模子的名字好像齐没写对……